回帰とは?

ここでは、回帰分析に焦点を当てて、説明していきます。

回帰分析は、1つ以上の入力(天気など)と出力したい内容(気温など)の間に何かしらの関係性を見出し、その関係性を数式に落とし込みます。この数式の目的としては、数値の予測と要因分析が主な目的となります。

ロジスティック回帰とは?

確率の回帰のことで、モデルに関しては、単純パーセプトロンと一緒です。

何が違うかというと、パラメーターを決める最適化問題で、SGD(確率的勾配降下法)を使用するものをパーセプトロンと呼び、座標降下法や準ニュートン法などを使用するものをロジスティック回帰と呼びます。

回帰にはそもそも、単回帰・重回帰・ロジスティック回帰とあります。

単回帰

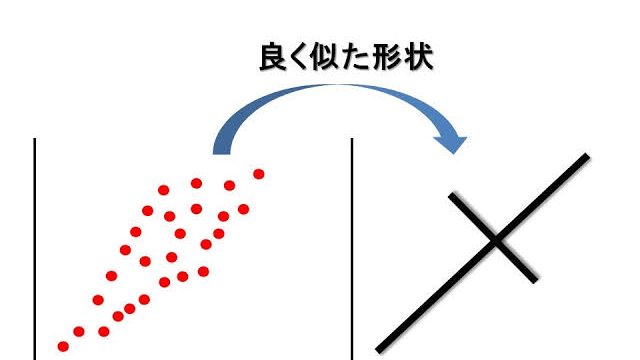

説明変数xが1つだけの回帰式を求めることを、単回帰分析と言います。

ex) y = ax + b ->代表的な線形単回帰です。

重回帰

説明変数xが2つ以上ある回帰式を求めることを、重回帰分析と言います。

ex) y = θ1×1 + θ2×2 + b ->代表的な線形重回帰です。

ロジスティック回帰

目的変数yが「買った or 買わなかった」のように「0か1のどちらかの値をとる2値変数」である場合、そのまま重回帰分析を行ってもあまり当てはまりの良い結果は得られません。

線形重回帰分析では「説明変数xが目的変数yの値に影響を与える」と仮定されるのに対して、ロジスティック回帰分析では「説明変数xが目的変数 y=1 となる確率に影響を与える」と仮定されます。